Meta hat ein neues Tool namens AI Studio vorgestellt, das es Nutzern in den USA ermöglicht, KI-Versionen von sich selbst für Instagram, WhatsApp, Messenger und das Web zu erstellen. Dieser Schritt markiert einen bedeutenden Fortschritt in Metas Bestrebungen, KI in soziale Medien zu integrieren und sowohl Erstellern als auch Geschäftsinhabern innovative Möglichkeiten zur Interaktion mit ihrem Publikum zu bieten.

Revolutionierung der sozialen Medien Interaktion

AI Studio ermöglicht es Nutzern, KI-Profile zu erstellen, die im Namen der Ersteller mit Followern interagieren können. Diese KI-Personen können an Chat-Threads teilnehmen und auf Kommentare antworten, wodurch eine nahtlose Erweiterung der Präsenz des Erstellers gewährleistet wird. Diese Fähigkeit ist besonders nützlich für Influencer, Prominente und Unternehmen, die eine konstante Interaktion mit ihrem Publikum aufrechterhalten möchten, ohne physisch anwesend zu sein.

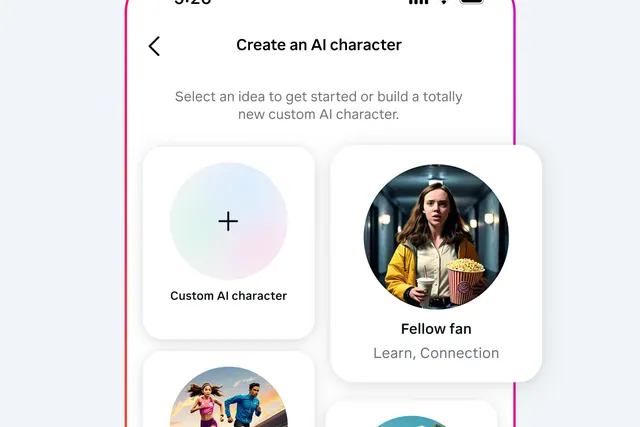

Um loszulegen, können Instagram-Nutzer in den USA über die Website von AI Studio oder durch Initiierung eines neuen „KI-Chats“ direkt in der Instagram-App auf das Tool zugreifen. Diese einfache Zugänglichkeit stellt sicher, dass auch Personen mit begrenztem technischen Know-how problemlos ihre KI-Personen erstellen und einsetzen können.

Anpassung und Kontrolle

Meta legt großen Wert auf Anpassung und Kontrolle in AI Studio. Ersteller können ihre KI basierend auf ihrem Instagram-Inhalt, bestimmten zu vermeidenden Themen und zu teilenden Links anpassen. Diese Anpassung stellt sicher, dass die KI der Marke und den Werten des Erstellers treu bleibt. Darüber hinaus können Ersteller automatische Antworten ein- und ausschalten sowie festlegen, mit welchen Konten die KI interagieren darf, was eine zusätzliche Kontrollschicht bietet.

Ein Blogbeitrag von Meta erläutert den AI-Erstellungsprozess und betont, dass Ersteller klar definieren müssen, welche Themen ihre KI nicht behandeln wird. Zum Beispiel kann eine KI angewiesen werden, nicht auf Fragen zur Investition in Kryptowährungen zu antworten. Diese Vorsichtsmaßnahme soll die Verbreitung potenziell schädlicher oder irreführender Informationen verhindern.

Erweiterung des KI-Ökosystems

Über persönliche KI-Profile hinaus ermöglicht AI Studio auch die Erstellung völlig neuer KI-Charaktere. Diese Charaktere können in der gesamten App-Suite von Meta eingesetzt werden, wodurch Meta zu einem Konkurrenten für Startups wie Character.AI und Replika wird, die thematische Chatbots für verschiedene Interaktionen anbieten. Ähnlich wie der benutzerdefinierte GPT-Store von OpenAI plant Meta, diese von Nutzern erstellten KI-Charaktere zu präsentieren, sodass andere mit ihnen interagieren können.

Metas anfänglicher Ansatz für dieses Konzept bestand darin, mit Prominenten zusammenzuarbeiten, um KI-Versionen von sich selbst zu erstellen, allerdings mit anderen Namen und Persönlichkeiten. Diese Strategie sollte das Risiko mindern, dass KI-Versionen von Prominenten kontroverse Aussagen machen. Trotz der eingebauten Kontrollen ist es jedoch wahrscheinlich, dass aufgrund der unvorhersehbaren Natur generativer KI einige Probleme auftreten werden.

Transparenz und ethische Überlegungen

Meta ist sich der potenziellen Fallstricke bewusst und stellt sicher, dass KI-Profile überall, wo sie erscheinen, klar gekennzeichnet sind. Ein Unternehmenshandbuch bietet detaillierte Anleitungen zum KI-Erstellungsprozess und legt die Verantwortung auf die Ersteller, nicht zu behandelnde Themen anzugeben. Diese Transparenz ist entscheidend, um das Vertrauen zwischen Erstellern und ihrem Publikum aufrechtzuerhalten.

Metas AI Studio stellt einen mutigen Vorstoß dar, KI mit sozialen Medien zu integrieren und Erstellern sowie Unternehmen beispiellose Möglichkeiten zur Interaktion zu bieten. Während sich diese Technologie weiterentwickelt, wird es entscheidend sein, ihre Auswirkungen zu überwachen und etwaige ethische Bedenken anzugehen. Mit AI Studio überschreitet Meta nicht nur die Grenzen der sozialen Medien Interaktion, sondern navigiert auch durch die komplexe Landschaft der KI-Ethik und des Nutzervertrauens.